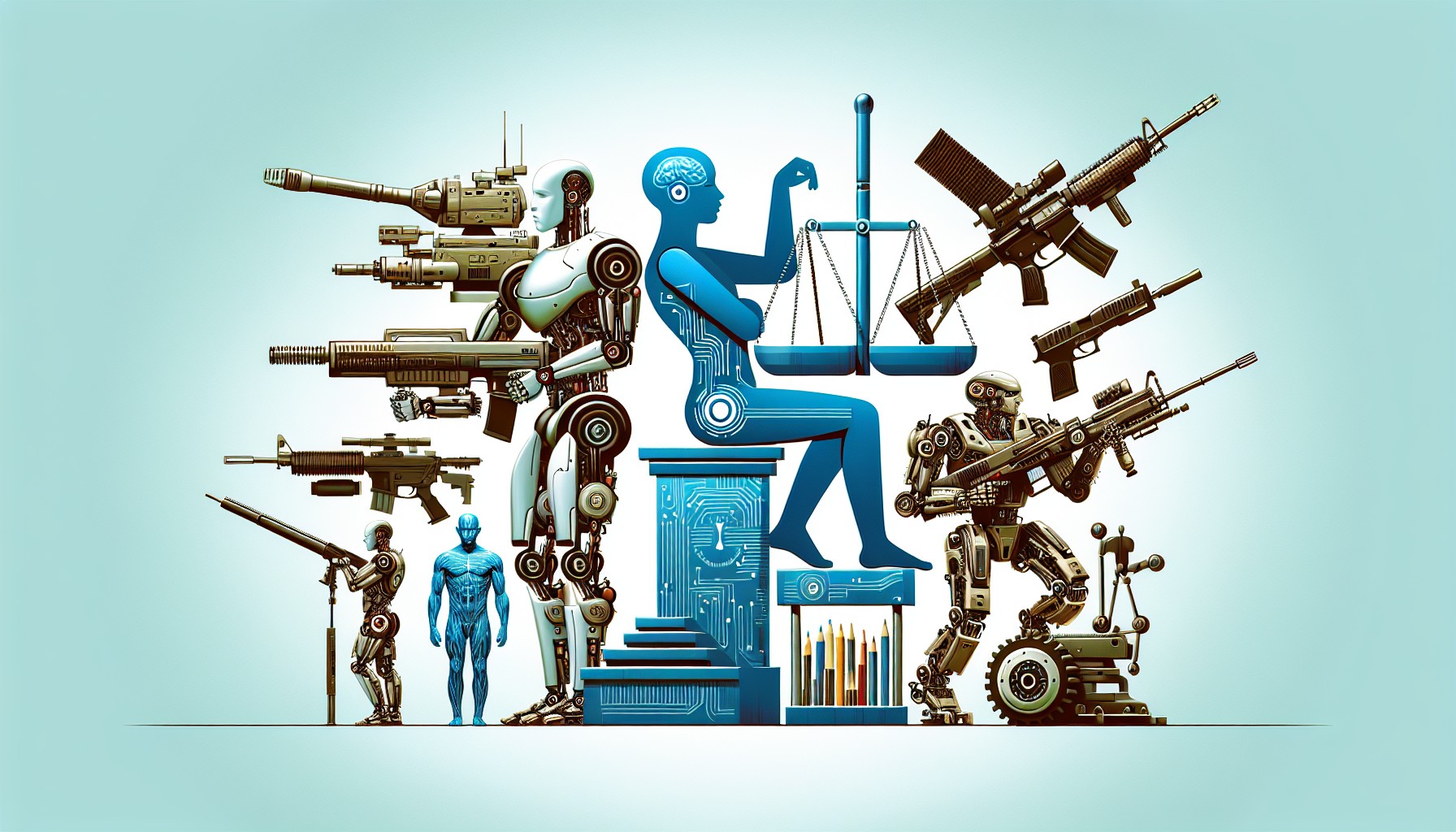

Les robots et les armes autonomes avec l'intelligence artificielle, menacent-ils l'éthique humaine ?

À l’aube d’une nouvelle ère technologique, le développement des robots militaires autonomes soulève des interrogations qui dépassent le cadre militaire. Alors que l’intelligence artificielle (IA) transforme divers secteurs, allant des soins de santé à la finance, l’intégration de ces systèmes dans des contextes de conflit pose des défis éthiques sans précédent. Les machines capables de prendre des décisions critiques sur le champ de bataille doivent être guidées par des principes moraux solides, car leurs actions peuvent avoir des conséquences irréversibles sur la vie humaine.

Loin d’être un simple débat académique, cette problématique touche à la nature même de notre humanité et à notre rapport à la technologie. Les avancées militaires en matière d’IA amplifient les questions de responsabilité, de contrôle et de moralité. Ces thèmes ont déjà été explorés par des penseurs et écrivains tels qu’Isaac Asimov. Ses lois de la robotique, bien que fictives, fournissent un cadre de réflexion pertinent sur la manière dont les machines devraient interagir avec les humains. À l’heure où des entreprises de défense collaborent avec des agences gouvernementales pour développer des systèmes autonomes, il est essentiel de se demander si ces machines seront capables de respecter nos valeurs fondamentales.

Les conséquences de cette évolution technologique ne se limitent pas à des scénarios de guerre. Les enjeux éthiques touchent également des domaines tels que la surveillance, la vie privée et les droits de l’homme. En tissant des liens entre ces différentes réalités, nous pouvons mieux appréhender l’ampleur des défis qui se présentent à nous. En somme, l’avenir des robots militaires et, plus largement, de l’intelligence artificielle dans notre société dépendra de notre capacité à définir des normes éthiques claires et à garantir que ces technologies servent véritablement l’humanité, sans la mettre en péril.

Robots militaires et éthique: Le programme Asimov de la DARPA

Les avancées technologiques dans le domaine militaire, notamment l’émergence de robots autonomes dotés d’intelligence artificielle, soulèvent des questions éthiques cruciales. Peut-on vraiment garantir que ces machines respectent les valeurs humaines fondamentales ? Cette problématique complexe est au cœur des réflexions actuelles, notamment à travers le prisme des lois imaginées par Isaac Asimov. À cet égard, la DARPA, l’agence de recherche militaire américaine, s’engage dans une exploration innovante pour établir des critères éthiques qui guideront l’utilisation de ces technologies.

Les trois lois d’Asimov: Une inspiration majeure

Contexte historique

Isaac Asimov, écrivain visionnaire de science-fiction, a formulé en 1942 les célèbres “trois lois de la robotique”. Ces règles, conçues pour protéger l’humanité, posent des bases éthiques essentielles dans le débat contemporain sur les robots et leur autonomie.

Détail des lois

Loi 1: Un robot ne peut nuire à un être humain ou, par son inaction, laisser un être humain exposé à un danger. Loi 2: Un robot doit obéir aux ordres des êtres humains, sauf si ces ordres entrent en conflit avec la première loi. Loi 3: Un robot doit protéger sa propre existence, tant que cela ne contredit pas la première ou la deuxième loi.

Limites des lois

Dans ses œuvres, Asimov a exploré les implications complexes et parfois inattendues de ces lois. Ses récits, bien qu’imaginaires, soulèvent des interrogations pertinentes sur la moralité et la responsabilité des machines, des questions qui résonnent aujourd’hui dans le cadre des systèmes autonomes militaires.

Le programme Asimov: Objectifs et problématiques

Objectifs du programme

Le programme Asimov, initié par la DARPA, a pour ambition d’évaluer comment les armes autonomes peuvent respecter les normes éthiques humaines. Plutôt que de développer de nouvelles armes, ce programme se concentre sur la création d’outils permettant d’analyser et de mesurer le comportement des robots dans des contextes militaires variés.

Méthodologie

Pour atteindre ces objectifs, plusieurs entreprises de pointe, dont Lockheed Martin et Raytheon, sont engagées dans cette initiative. Leur mission consiste à modéliser des environnements virtuels complexes, où ils peuvent tester la variabilité des situations et évaluer les défis éthiques que chaque scénario présente.

Partenariat

Ce partenariat stratégique entre la DARPA et ces entreprises technologiques vise à établir des normes qui pourraient influencer les réglementations internationales sur l’utilisation des armes autonomes, un domaine en pleine évolution.

Les limites de l’éthique dans les systèmes autonomes

Subjectivité des normes éthiques

Les normes éthiques humaines sont souvent marquées par une forte subjectivité, variant considérablement d’une culture à l’autre. Les systèmes autonomes, basés sur des algorithmes rigides, trouvent difficilement leur place dans cet écosystème complexe.

Dilemmes moraux en situation de combat

Les situations imprévues qui peuvent survenir sur le champ de bataille posent un défi majeur. Comment un robot peut-il naviguer dans un dilemme moral ? La prise de décision éthique dans des contextes extrêmes demeure un sujet de débat intense. Les avis d’experts et de chercheurs divergent sur ce sujet, soulignant la complexité de ces enjeux.

L’héritage d’Asimov et l’avenir des robots militaires

Vision d’Asimov

Isaac Asimov a toujours défendu l’idée que les robots devraient être des serviteurs de l’humanité, agissant dans l’intérêt supérieur de la société. Bien que ses lois soient issues de la fiction, elles inspirent des programmes concrets, comme celui de la DARPA, qui tentent de les appliquer dans des contextes réels, notamment militaires.

Perspectives futures

La DARPA reconnaît toutefois que le programme Asimov ne résoudra pas toutes les questions éthiques liées à l’utilisation des technologies autonomes. Néanmoins, il représente une avancée significative vers l’établissement de normes plus strictes et potentielles pour encadrer ces technologies. Les travaux en cours pourraient ouvrir la voie à des régulations internationales plus robustes, essentielles pour garantir que l’avenir des robots militaires soit conforme aux valeurs humaines.

Conclusion

En somme, l’intersection entre technologie militaire et éthique est un domaine en pleine évolution qui nécessite une réflexion approfondie. Les travaux de la DARPA, inspirés par les lois d’Asimov, offrent une perspective prometteuse sur la manière d’aborder ces défis. Quels critères éthiques devraient être établis pour encadrer l’utilisation des robots militaires ? Cette question demeure ouverte et appelle à un débat continu impliquant des experts, des décideurs et le grand public.

À l’intersection de l’innovation technologique et des valeurs humaines se dessine un paysage complexe où les robots militaires autonomes prennent une place prépondérante. Les lois d’Isaac Asimov, bien que fictives, résonnent aujourd’hui avec une acuité particulière et posent des interrogations essentielles sur la moralité dans la prise de décision des machines. Les efforts de la DARPA pour évaluer le comportement éthique des systèmes autonomes soulignent l’urgence de doter ces technologies de cadres éthiques robustes.

Au-delà des implications militaires, ces questionnements touchent à des enjeux sociétaux plus larges, tels que la responsabilité individuelle et collective en matière de technologie. L’usage croissant de l’intelligence artificielle dans divers secteurs appelle à une réflexion sur la manière dont ces outils peuvent être alignés avec les principes fondamentaux de la dignité humaine.

Les dilemmes moraux auxquels sont confrontés ces systèmes autonomes mettent en évidence la nécessité d’une vigilance constante. Dans un monde où les décisions peuvent être prises par des algorithmes, il devient crucial d’explorer les ramifications éthiques et sociales de ces évolutions. La recherche d’un équilibre entre innovation et éthique représente une responsabilité collective qui nécessite l’engagement de toutes les parties prenantes, qu’il s’agisse des chercheurs, des législateurs ou du grand public. Une réflexion approfondie sur ces questions pourrait façonner l’avenir de notre société et déterminer comment nous coexisterons avec ces technologies avancées.

Aller plus loin

Pour enrichir votre compréhension des enjeux éthiques liés à l’intelligence artificielle et aux robots militaires, il existe une multitude de ressources fascinantes à explorer.

Commencez votre voyage par le site de l’AI Ethics Lab. Ici, vous trouverez des analyses approfondies qui scrutent les questions éthiques entourant l’intelligence artificielle. À travers des articles éclairants et des études de cas pertinentes, ce laboratoire de réflexion vous invite à plonger dans les implications sociales et morales des technologies émergentes. C’est une véritable mine d’informations pour quiconque souhaite se poser des questions critiques sur l’avenir numérique.

Poursuivez votre exploration avec le Future of Life Institute, un institut dédié à l’étude des technologies susceptibles d’impacter profondément l’humanité. Ce site regorge de ressources et de rapports qui abordent la sécurité de l’IA, la robotique et les défis éthiques qui en découlent. En y naviguant, vous découvrirez des perspectives qui vous aideront à saisir les enjeux cruciaux de notre époque.

Un autre incontournable est l’IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems. Cette initiative mondiale de l’Institute of Electrical and Electronics Engineers (IEEE) s’attaque aux défis éthiques liés aux systèmes autonomes. En parcourant ce site, vous accéderez à des lignes directrices et à des publications qui alimenteront votre réflexion sur l’éthique en ingénierie et en technologie.

Ne manquez pas de visiter le Center for Humane Technology, qui se concentre sur l’impact des technologies sur notre société. Cette organisation passionnante propose des ressources et des initiatives visant à promouvoir des pratiques technologiques qui favorisent le bien-être humain. En découvrant leur travail, vous serez inspiré à penser à la manière dont la technologie peut être utilisée pour le bénéfice de tous.

Un autre site à explorer est le OpenAI Blog, où les réflexions et les recherches sur l’intelligence artificielle sont partagées avec une grande clarté. Ce blog aborde des questions techniques, éthiques et sociétales, vous offrant une vue d’ensemble précieuse des enjeux contemporains liés à l’IA. C’est un excellent moyen de rester informé des dernières avancées dans ce domaine dynamique.

Enfin, le rapport de l’Académie des sciences sur les enjeux éthiques de l’IA offre une analyse exhaustive des défis éthiques associés à l’intelligence artificielle. Ce document essentiel examine les implications pour la société, la sécurité et la responsabilité, et il s’adresse à tous ceux qui souhaitent comprendre les enjeux à long terme. En le consultant, vous acquerrez des connaissances qui vous aideront à naviguer dans le paysage complexe de l’IA.

Ces ressources vous permettront d’approfondir vos réflexions sur l’utilisation de l’intelligence artificielle et des systèmes autonomes, tout en mettant en lumière les dimensions éthiques cruciales qui en découlent. N’hésitez pas à partager vos réflexions sur ces lectures essentielles et à suivre ces plateformes pour rester informé des avancées dans ce domaine fascinant.